Apa spesifikasi terpenting untuk PC AI Lokal di tahun 2026? Meskipun jumlah inti GPU sangat penting, mesin performa sebenarnya untuk Model Bahasa Besar (LLM) dan AI Generatif adalah Bandwidth VRAM (GB/s) .

Model AI lokal membutuhkan sejumlah besar data untuk dipertukarkan antara memori dan prosesor secara instan; jika bandwidth Anda rendah, GPU kelas atas Anda akan "menganggur" sambil menunggu data, yang menyebabkan pembuatan token menjadi lambat.

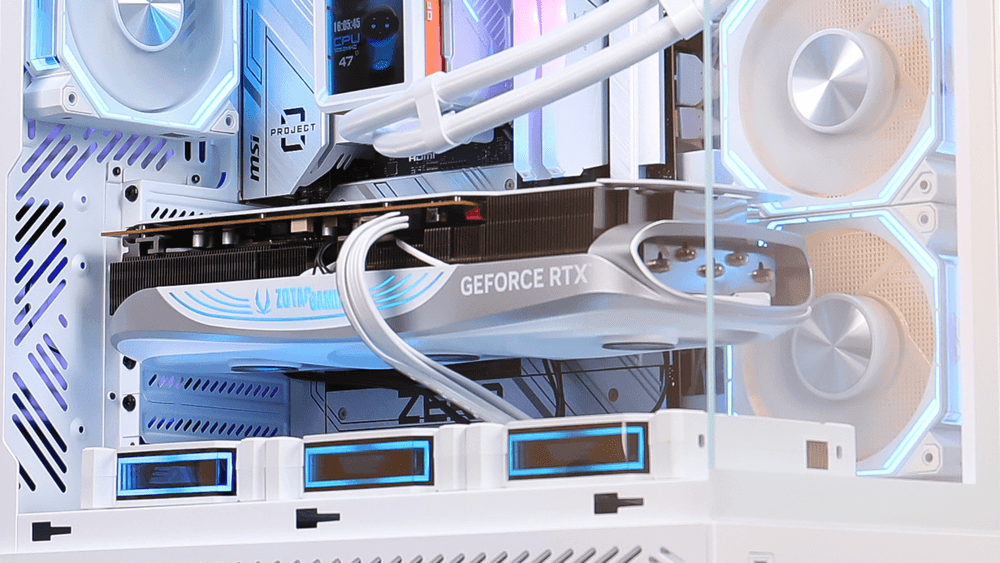

Selain itu, beban 100% yang berkelanjutan dari inferensi AI menghasilkan titik panas VRAM yang ekstrem, sehingga manajemen termal berkinerja tinggi, seperti pendingin cair AIO , sangat penting untuk mencegah pelambatan termal dan mempertahankan throughput AI puncak.

Bandwidth VRAM vs. Kapasitas VRAM: Kesenjangan Kinerja AI di Tahun 2026

Di era Llama 4 dan Stable Diffusion Ultra, banyak pembuat model grafis salah mengartikan "Kapasitas VRAM" (GB) sebagai "Kecepatan AI." Meskipun kapasitas menentukan apakah sebuah model dapat muat di kartu grafis Anda, Bandwidth VRAM menentukan seberapa cepat model tersebut berjalan.

Throughput Data

LLM (Low-Level Matrix) melakukan miliaran perkalian matriks. Memori GDDR7 berkecepatan tinggi yang terdapat pada seri RTX 50 menyediakan bandwidth 1.000GB/s+ yang diperlukan untuk menghasilkan teks dan gambar secara real-time.

Dinding Kenangan

Jika bandwidth Anda menjadi hambatan, meningkatkan kecepatan clock GPU Anda tidak akan memberikan peningkatan kinerja sama sekali. Inilah mengapa workstation AI profesional memprioritaskan lebar dan kecepatan bus memori daripada TFLOPS mentah.

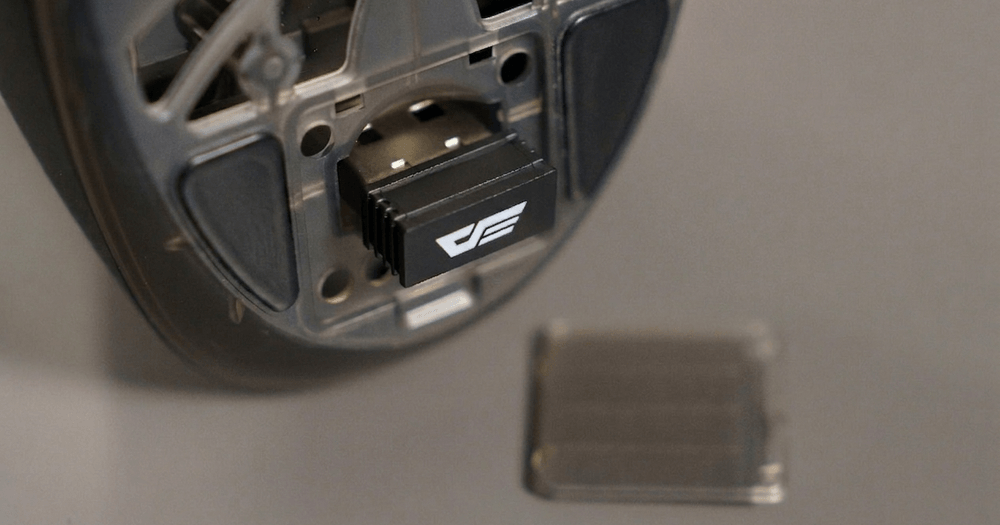

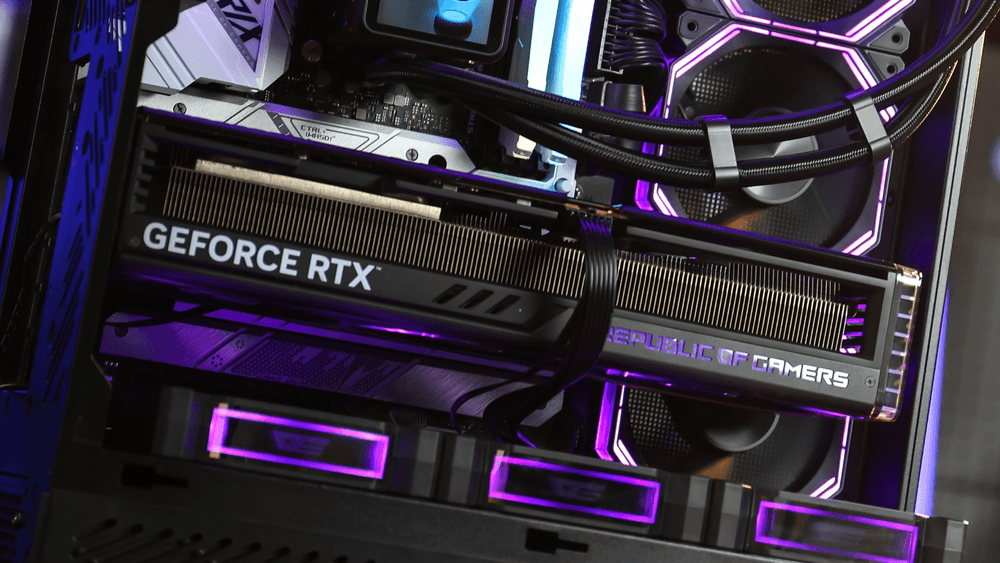

Tekanan Termal pada Beban Kerja AI: Mengatasi Masalah Hotspot VRAM

Tidak seperti game yang memiliki beban "ledakan" yang berfluktuasi, inferensi AI lokal menjaga penggunaan GPU dan CPU Anda tetap 100% selama beberapa menit atau bahkan berjam-jam.

Pembunuh Senyap: VRAM yang Terlalu Panas

Operasi bandwidth tinggi menghasilkan panas yang sangat tinggi di dalam modul memori. Jika VRAM Anda mencapai 95°C, BIOS GPU akan secara otomatis "menurunkan clock" frekuensi memori, menyebabkan kecepatan pembuatan AI Anda turun hingga 40%.

Pengiriman Daya Berkelanjutan

Beban kerja AI membutuhkan daya tinggi yang konstan. Dengan menggunakan PSU bersertifikasi ATX 3.1 , seperti seri darkFlash PMT , sistem Anda dapat menangani kebutuhan daya terus-menerus ini tanpa riak tegangan yang dapat menyebabkan model AI Anda mengalami crash di tengah perhitungan.

Mendinginkan Si Monster AI: Mengapa Anda Membutuhkan Pendingin Cair 360mm dan Aliran Udara Langsung

Untuk menjaga agar PC AI lokal tetap stabil selama pelatihan atau inferensi 24/7, infrastruktur termal Anda haruslah yang terbaik.

Mencegah Kemacetan CPU

Sementara GPU melakukan tugas berat, CPU menangani pra-pemrosesan data dan pembagian model. Pendingin AIO berperforma tinggi sangat penting untuk menjaga CPU tetap dingin, memastikan CPU dapat mengirimkan data ke GPU dengan cukup cepat untuk memenuhi bandwidth VRAM.

( Pendingin AIO darkFlash DV360S MAX )

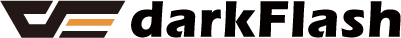

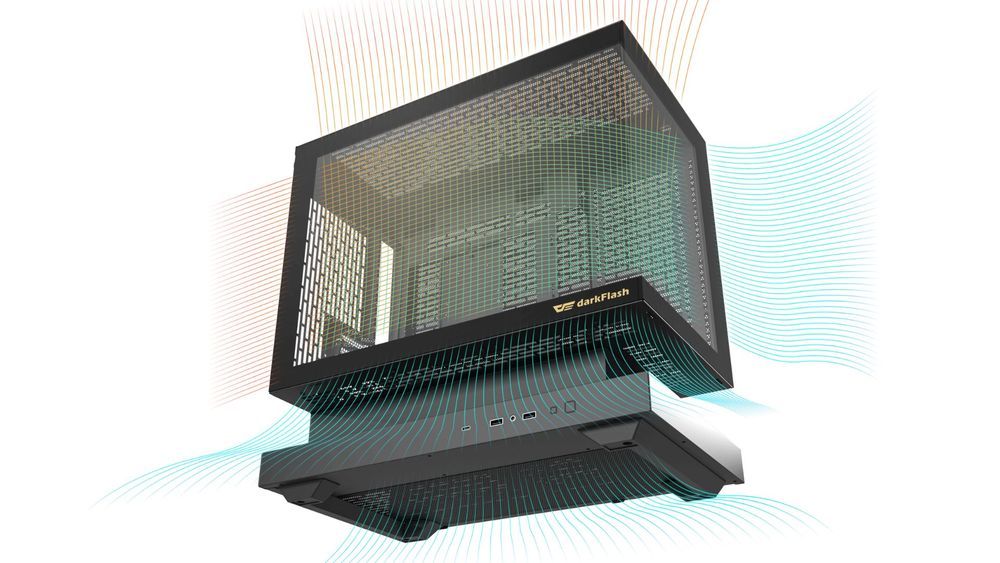

Keunggulan Saluran Masuk Samping

Dalam rakitan AI tahun 2026, aliran udara tradisional dari depan ke belakang seringkali tidak mencukupi. Casing seperti darkFlash FLOATRON F1 PC Case menggunakan kipas Side-Intake untuk meniup udara dingin langsung ke backplate memori GPU, sehingga secara signifikan menurunkan suhu VRAM selama sesi AI yang panjang.

( Casing PC darkFlash FLOATRON F1 , dengan konfigurasi tekanan positif)

Kesimpulan: Di Era AI, Stabilitas Termal adalah Kunci Kinerja

Pada tahun 2026, membangun PC untuk AI membutuhkan perubahan pola pikir. Ini bukan lagi tentang kecepatan puncak yang tinggi; ini tentang bandwidth berkelanjutan dan daya tahan termal . Tanpa fondasi pendinginan kelas atas dari darkFlash, GPU mahal Anda yang siap untuk AI tidak akan pernah mencapai potensi penuhnya.

Apakah desktop Anda siap untuk revolusi AI? Tingkatkan ke solusi pendinginan dan daya berkinerja tinggi untuk memastikan LLM lokal Anda berjalan dengan kecepatan maksimum tanpa hambatan.