Was ist die wichtigste Spezifikation für einen Local AI PC im Jahr 2026? Während die Anzahl der GPU-Kerne von entscheidender Bedeutung ist, ist die wahre Leistungsmaschine für große Sprachmodelle (LLMs) und generative KI die VRAM-Bandbreite (GB/s) .

Lokale KI-Modelle benötigen riesige Datenmengen, die sofort zwischen Speicher und Prozessor ausgetauscht werden müssen; bei geringer Bandbreite steht Ihre High-End-GPU im Leerlauf, während sie auf Daten wartet, was zu einer langsamen Token-Generierung führt.

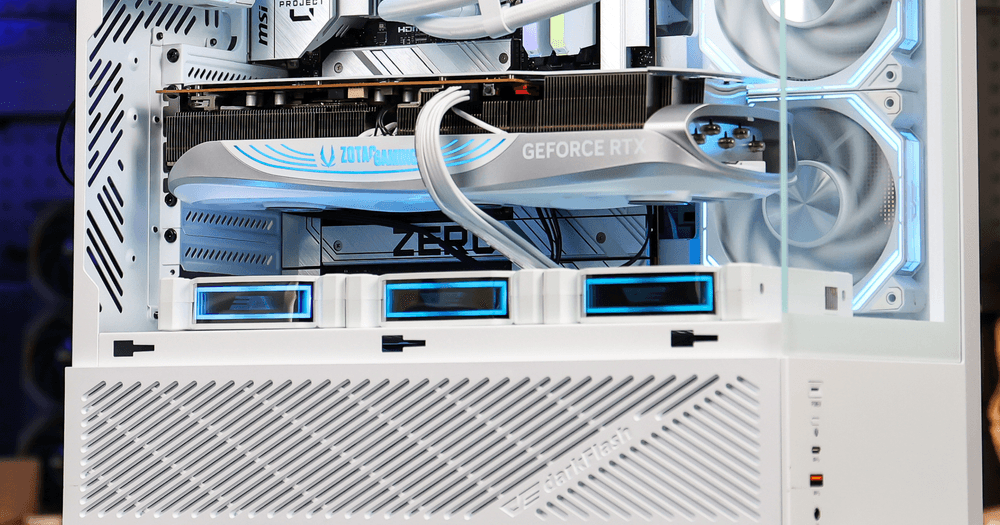

Darüber hinaus erzeugt die anhaltende 100%ige Auslastung durch KI-Inferenz extreme VRAM-Hotspots , wodurch ein leistungsstarkes Wärmemanagement, wie beispielsweise ein AIO-Flüssigkeitskühler , unerlässlich ist, um thermisches Drosseln zu verhindern und den maximalen KI-Durchsatz aufrechtzuerhalten.

VRAM-Bandbreite vs. VRAM-Kapazität: Die KI-Leistungslücke im Jahr 2026

Im Zeitalter von Llama 4 und Stable Diffusion Ultra verwechseln viele PC-Bauer die „VRAM-Kapazität“ (GB) mit der „KI-Geschwindigkeit“. Während die Kapazität bestimmt, ob ein Modell auf Ihre Karte passt , bestimmt die VRAM-Bandbreite, wie schnell es läuft.

Datendurchsatz

LLMs führen Milliarden von Matrixmultiplikationen durch. Der in der RTX-50-Serie verbaute Hochgeschwindigkeits -GDDR7-Speicher bietet die notwendige Bandbreite von über 1.000 GB/s, um Text und Bilder in Echtzeit zu generieren.

Die Erinnerungswand

Wenn die Bandbreite der Flaschenhals ist, bringt eine Erhöhung des GPU-Takts keine Leistungssteigerung. Deshalb priorisieren professionelle KI-Workstations die Speicherbusbreite und -geschwindigkeit gegenüber der reinen TFLOPS-Zahl.

Thermische Belastung bei KI-Workloads: Lösung des VRAM-Hotspot-Problems

Im Gegensatz zu Spielen, bei denen es zu schwankenden Lastspitzen kommt, hält die lokale KI-Inferenz Ihre GPU und CPU minuten- oder sogar stundenlang zu 100 % ausgelastet.

Der stille Killer: VRAM-Überhitzung

Operationen mit hoher Bandbreite erzeugen intensive Wärme in den Speichermodulen. Erreicht Ihr VRAM 95 °C, reduziert das GPU-BIOS automatisch die Speicherfrequenz, wodurch die KI-Generierungsgeschwindigkeit um bis zu 40 % sinkt.

Kontinuierliche Stromversorgung

KI-Workloads erfordern eine konstante, hohe Leistungsaufnahme. Die Verwendung eines ATX 3.1-zertifizierten Netzteils , wie beispielsweise der darkFlash PMT-Serie , stellt sicher, dass Ihr System diese kontinuierliche Leistungsaufnahme ohne Spannungsschwankungen bewältigt, die Ihr KI-Modell mitten in der Berechnung zum Absturz bringen könnten.

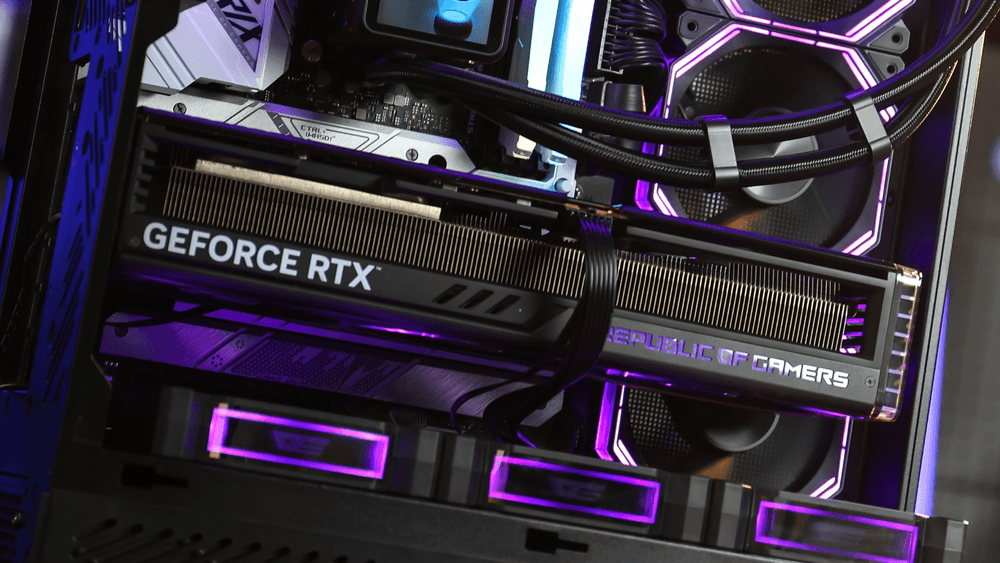

Kühlung für die KI-Maschine: Warum Sie eine 360-mm-Flüssigkeitskühlung und direkte Luftzufuhr benötigen

Um einen Local AI PC während des 24/7-Trainings oder der Inferenz stabil zu halten, muss Ihre thermische Infrastruktur erstklassig sein.

Vermeidung von CPU-Engpässen

Während die GPU die rechenintensiven Aufgaben übernimmt, kümmert sich die CPU um die Datenvorverarbeitung und das Sharding der Modelle. Eine leistungsstarke All-in-One-Wasserkühlung ist unerlässlich, um die CPU kühl zu halten und sicherzustellen, dass sie der GPU schnell genug Daten zuführen kann, um die VRAM-Bandbreite voll auszunutzen.

( darkFlash DV360S MAX AIO-Kühler )

Der Vorteil der seitlichen Lufteinlassöffnung

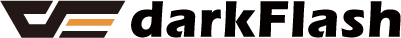

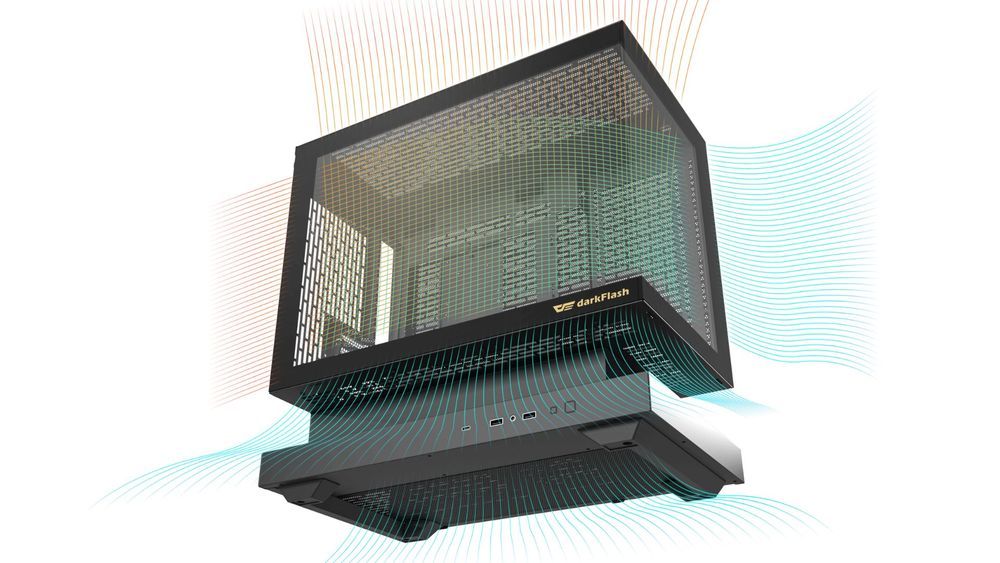

Bei KI-Systemen des Jahres 2026 reicht die herkömmliche Luftzirkulation von vorne nach hinten oft nicht aus. Gehäuse wie das darkFlash FLOATRON F1 PC-Gehäuse nutzen seitliche Lüfter , die kalte Luft direkt auf die Speicherrückplatte der GPU blasen und so die VRAM-Temperaturen bei langen KI-Sitzungen deutlich senken.

( darkFlash FLOATRON F1 PC-Gehäuse , mit Überdruckkonfiguration)

Fazit: Im Zeitalter der KI ist thermische Stabilität ein entscheidender Leistungsfaktor.

Im Jahr 2026 erfordert der Bau eines PCs für KI ein Umdenken. Es geht nicht mehr um maximale Spitzenleistung, sondern um dauerhafte Bandbreite und thermische Belastbarkeit . Ohne eine hochwertige Kühlbasis von darkFlash wird Ihre teure, KI-fähige GPU niemals ihr volles Potenzial entfalten können.

Ist Ihr Desktop-PC bereit für die KI-Revolution? Rüsten Sie auf leistungsstarke Kühl- und Stromversorgungslösungen auf, um sicherzustellen, dass Ihre lokalen LLMs mit maximaler Geschwindigkeit und ohne Drosselung laufen.