2026年のローカルAI PCにとって最も重要な仕様は何ですか? GPUコア数は重要ですが、大規模言語モデル(LLM)と生成AIの真のパフォーマンスエンジンはVRAM帯域幅(GB/s)です。

ローカルAIモデルでは、メモリとプロセッサ間で膨大な量のデータを瞬時にやり取りする必要があります。帯域幅が低い場合、高性能GPUはデータ待ちの間「アイドル状態」になり、トークン生成が遅くなります。

さらに、AI推論の負荷が100%の状態が持続すると、 VRAMに極端なホットスポットが発生するため、サーマルスロットリングを防ぎ、AIのスループットを最大限維持するには、 AIO水冷クーラーなどの高性能な熱管理が不可欠となる。

VRAM帯域幅とVRAM容量:2026年のAIパフォーマンスギャップ

Llama 4やStable Diffusion Ultraの時代において、多くの開発者は「VRAM容量」(GB)を「AI速度」と混同しています。容量はモデルがグラフィックカードに収まるかどうかを決定するものであり、 VRAM帯域幅はモデルの実行速度を決定するものです。

データスループット

LLM(論理行列演算モジュール)は、数十億回の行列乗算を実行します。RTX 50シリーズに搭載されている高速GDDR7メモリは、テキストや画像をリアルタイムで生成するために必要な1,000GB/秒以上の帯域幅を提供します。

メモリアルウォール

帯域幅がボトルネックになっている場合、GPUのクロック速度を上げてもパフォーマンスは向上しません。これが、プロフェッショナル向けAIワークステーションが、純粋なTFLOPS値よりもメモリバスの幅と速度を優先する理由です。

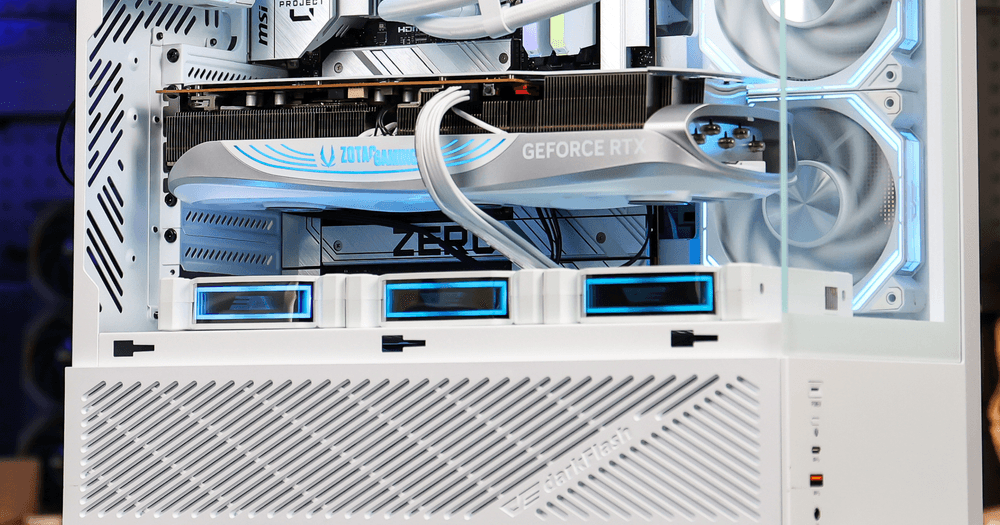

AIワークロードにおける熱ストレス:VRAMホットスポット問題の解決

ゲームのように負荷が変動する「バースト」とは異なり、ローカルAI推論では、GPUとCPUの利用率が数分から数時間にわたって100%に維持されます。

静かなる殺人者:VRAMの過熱

高帯域幅の処理では、メモリモジュール内部で激しい熱が発生します。VRAMの温度が95℃に達すると、GPU BIOSは自動的にメモリ周波数を「ダウンクロック」し、AI生成速度が最大40%低下します。

持続的な電力供給

AI処理には、一定の高出力電力が必要です。darkFlash PMTシリーズのようなATX 3.1認証済みの電源ユニットを使用することで、AIモデルの計算中にクラッシュする可能性のある電圧リップルが発生することなく、システムがこれらの継続的な電力消費に対応できるようになります。

AIモンスターを冷却する:360mm水冷とダイレクトエアフローが必要な理由

ローカルAI PCを24時間365日稼働のトレーニングや推論中に安定させるには、最高レベルの熱管理インフラが必要です。

CPUボトルネックの防止

GPUが主要な処理を担う一方、CPUはデータの前処理とモデルの分割を担当します。高性能な一体型水冷クーラーは、CPUを冷却し、VRAMの帯域幅を最大限に活用できる速度でGPUにデータを供給できるようにするために不可欠です。

( darkFlash DV360S MAX AIOクーラー)

サイドインテークの利点

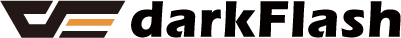

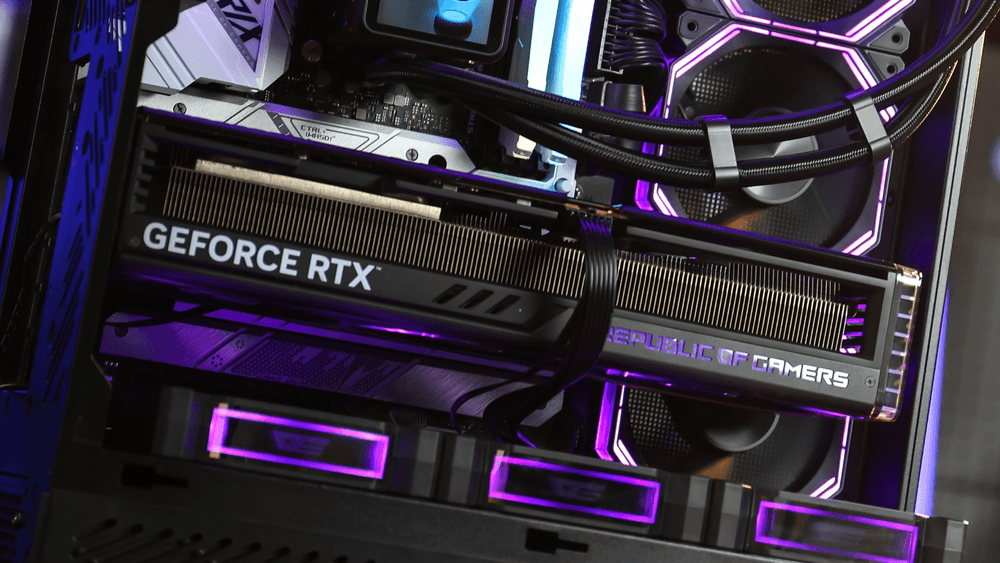

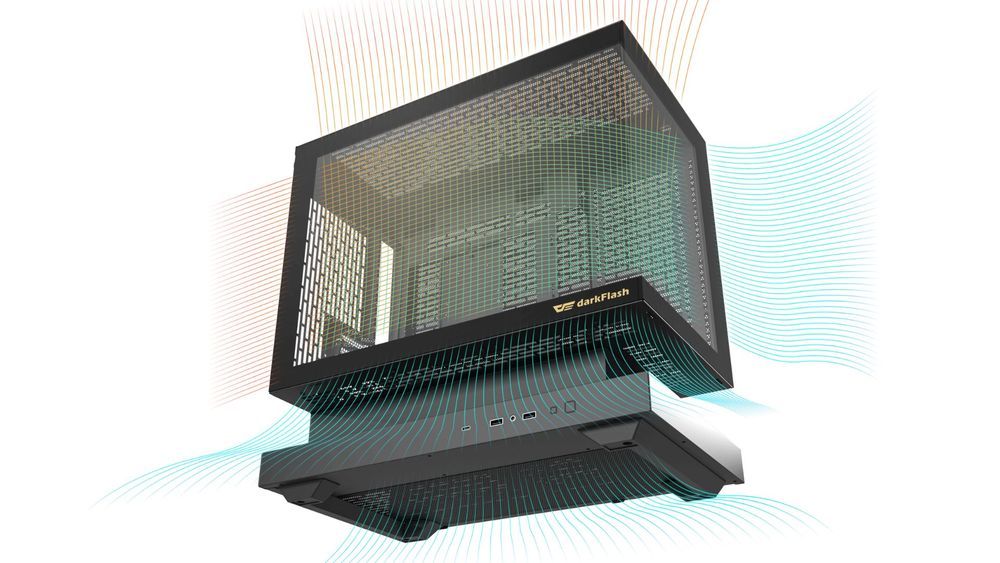

2026年版AIシステムでは、従来の前面から背面へのエアフローでは不十分な場合が多い。darkFlash FLOATRON F1 PCケースのようなシャーシは、側面吸気ファンを採用し、冷気をGPUのメモリバックプレートに直接吹き付けることで、長時間のAIセッション中のVRAM温度を大幅に低下させる。

( darkFlash FLOATRON F1 PCケース、正圧構成)

結論:AI時代において、熱安定性はパフォーマンスである

2026年、AI向けPCの構築には考え方の転換が求められます。もはやピーク時のバースト速度ではなく、持続的な帯域幅と熱耐性が重要になります。darkFlashの高性能冷却システムがなければ、高価なAI対応GPUもその真価を発揮することはできません。

お使いのデスクトップはAI革命に対応できていますか?高性能な冷却システムと電源ソリューションにアップグレードすることで、ローカルのLLMがスロットリングを起こすことなく最大限の速度で動作することを保証します。